ソフトマックス関数(Softmax function) |

|||||||||||||||||||

・機械学習への適用 ・ステップ , 符号関数 ・シグモイド ・ReLU ・Softmax ・tanh ・NN ・CNN ・ディープラーニング

・DQNとは_スキナー箱 ・cartpole問題 ・Experience Replay

|

・In English

■ソフトマックス関数とは

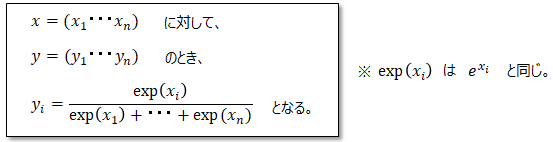

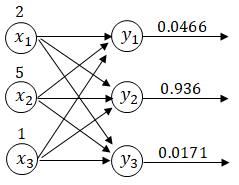

ソフトマックス関数(Softmax function)とはニューラルネットワークでよく用いられる活性化関数の一つで、以下の様に関数の合計値が1となるように正規化する関数です。

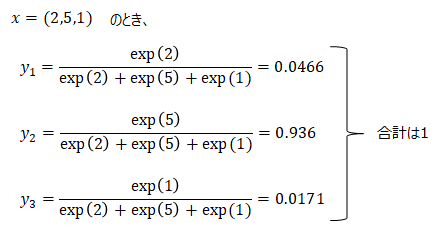

これが何を示しているか、具体例として以下の様にxを与えた時のyの計算結果を示します。 ■割合い計算とソフトマックス関数との違い

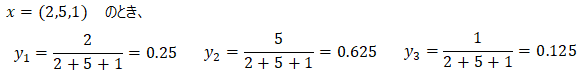

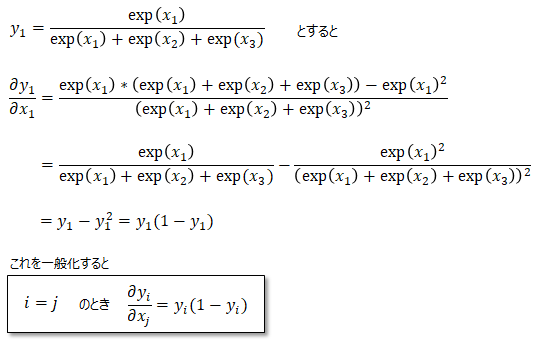

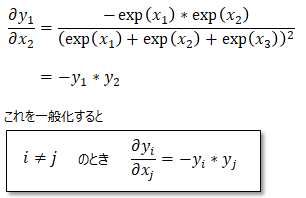

正規化するなら以下の様な計算方法でも良い筈ですが、ソフトマックス関数にする事のメリットは何でしょうか。 ■ソフトマックス関数の微分

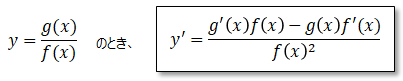

以下有理関数の微分を用います。

サブチャンネルあります。⇒ 何かのお役に立てればと

|

|

|||||||||||||||||